Bài viết được ghim

Độ hot của Langchain

Langchain là một framework vô cùng hot hit trong thời gian gần đây. Nó được sinh ra để tận dụng sức mạnh của các mô hình ngôn ngữ lớn LLM như ChatGPT, LLaMA... để tạo ra các ứng dụng trong thực tế. Dù mới được phát triển cách đây khoảng 6 tháng (10/2022) và vẫn được cập nhật liên tục hàng ngày nhưng trên Github Langchain đã nhận được những tương tác khủng với lượng star lê...

Tất cả bài viết

Lời mở đầu

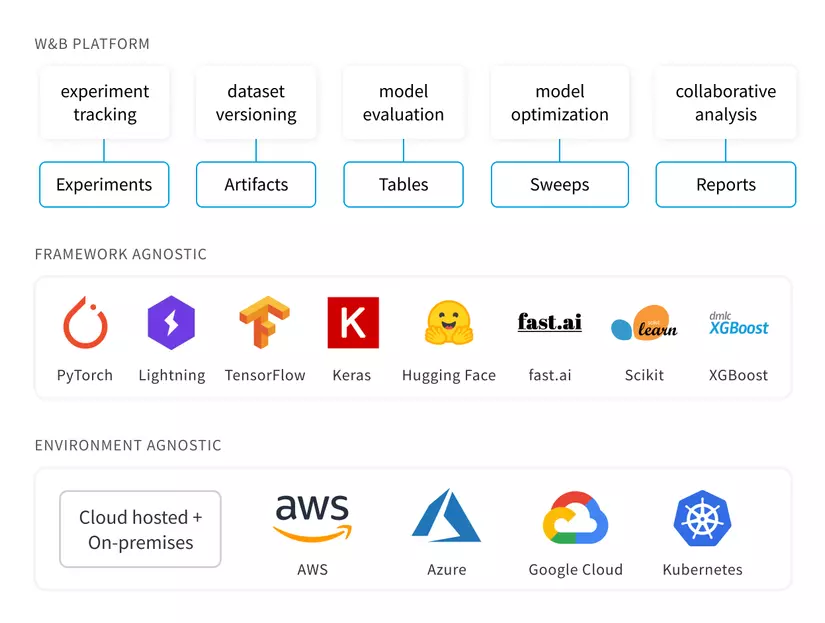

- Thứ nhất, bài viết này tham khảo từ W&B documentation, có sửa đổi một chút: chắt lọc các thông tin, chức năng quan trọng của W&B mà người dùng cần

- Thứ hai, bài viết này mới chỉ cover được 2/7 phần của W&B, nếu có gì thiếu sót xin mọi người bỏ qua cho. Trong thời gian tới tôi sẽ cập nhật các phần tiếp theo

- Thứ ba, bài viết này khá dài, mọi người có thể tìm phần mình cảm th...

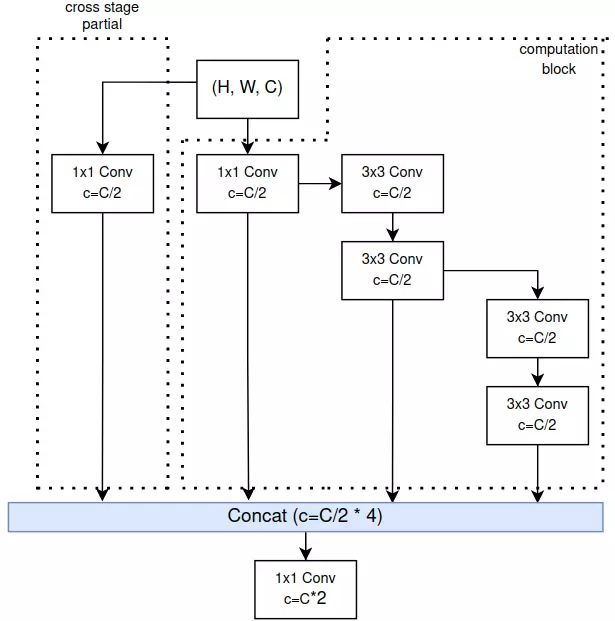

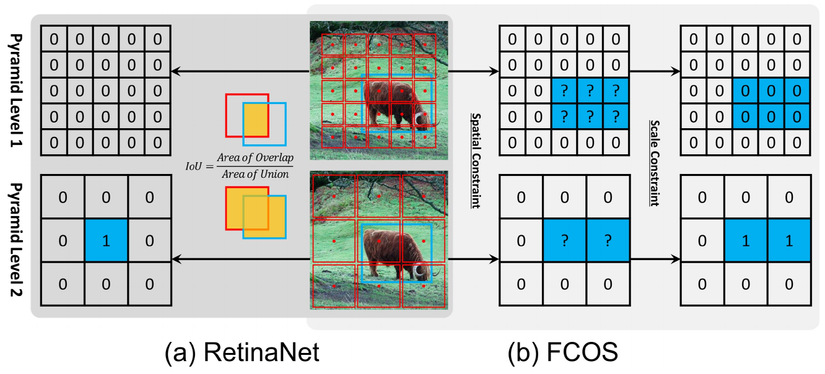

Mở đầu Ở bài viết lần trước, mình đã trình bày sơ qua các kiến thức các bạn sẽ gặp phải trong YOLOv7, nếu muốn các bạn có thể đọc lại ở đây: https://viblo.asia/p/paper-explain-yolov7-su-dung-cac-trainable-bag-of-freebies-dua-yolo-len-mot-tam-cao-moi-phan-1-zXRJ8BGOVGq. Ở phần 1, mình có nhắc tới khái niệm Label Assignment và đã giải thích sơ qua. Tuy nhiên, đối với các model Object Detection th...

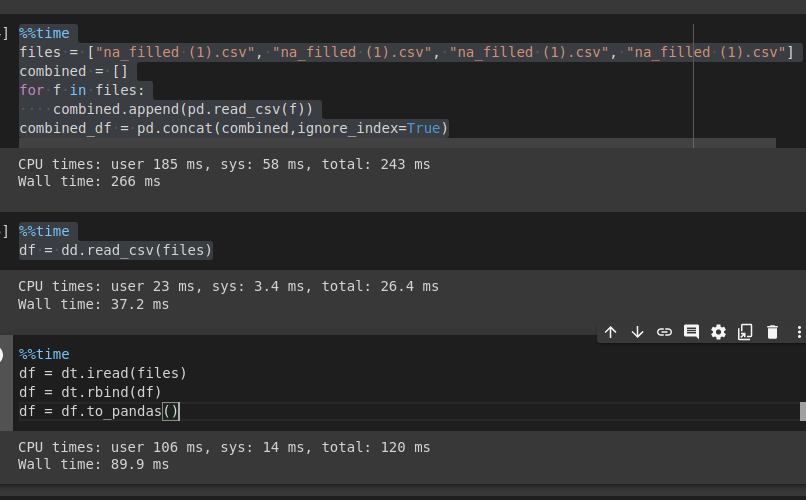

Khi nhắc đến xử lý dữ liệu bảng thì đa số chúng ta sẽ lựa chọn Pandas để đọc và thao tác với dữ liệu, và mình cũng không ngoại lệ. Tuy nhiên, mình vừa đọc được một bài viết khá là hay để xem xem liệu rằng Pandas có phải là lựa chọn tốt nhất không? Ở bài viết này chúng ta sẽ cùng so sánh hiệu suất của các package: Pandas, Dask, Datatable.

Pandas Pandas là một thư viện của Python được mọi người ...

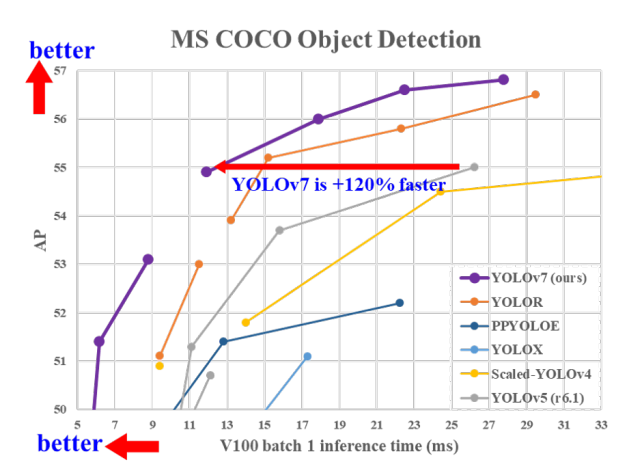

Mở đầu Chắc hẳn mọi người đã không còn xa lạ gì với cái tên YOLO, làm mưa làm gió trong bài toán Object Detection với tốc độ cực nhanh mà vẫn có độ chính xác khá cao. Bộ đôi WongKinYiu và Alexey đã có khá nhiều đóng góp cho họ nhà YOLO với YOLOv4, Scaled-YOLOv4, YOLOR và đến gần đây là một bản cập nhật cực kì khủng khiếp: YOLOv7. Mình xin dịch nguyên cái tóm tắt cực kì trẻ trâu của YOLOv7 như ...

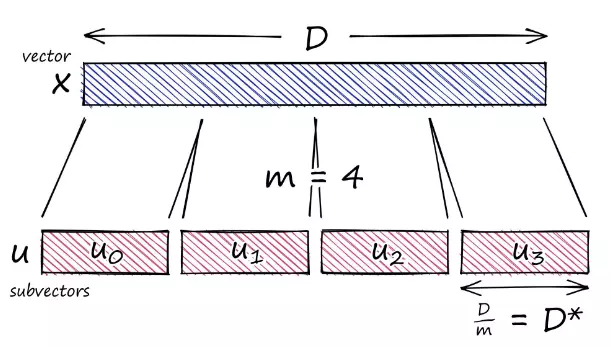

Tổng quan Hiện nay với sự phát triển của công nghệ, các nền tảng mảng xã hội, báo trí, truyền thông ...vv. Chúng ta liên tục được tiếp cận với nhiều nguồn thông tin khác nhau, do đó nhu cầu của con người trong việc chọn lọc và sử dụng thông tin cũng ngày càng cao. Các bài toán về gợi ý người dùng, tìm kiếm xu hướng (trending), chat bot ... đã và đang ngày càng được cải tiến và phát triển. Vậy t...

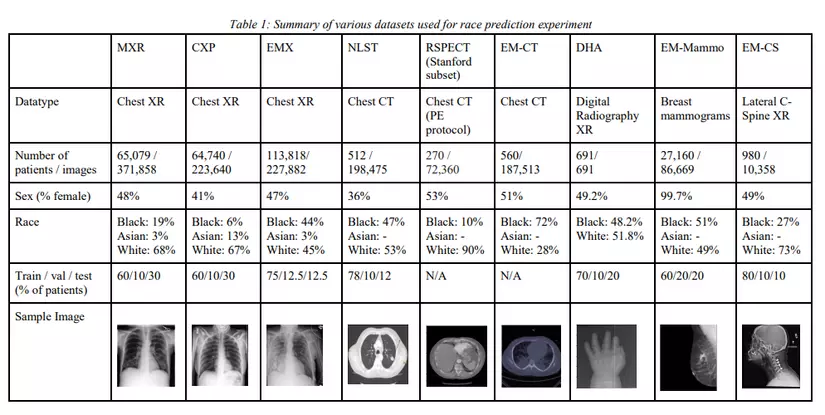

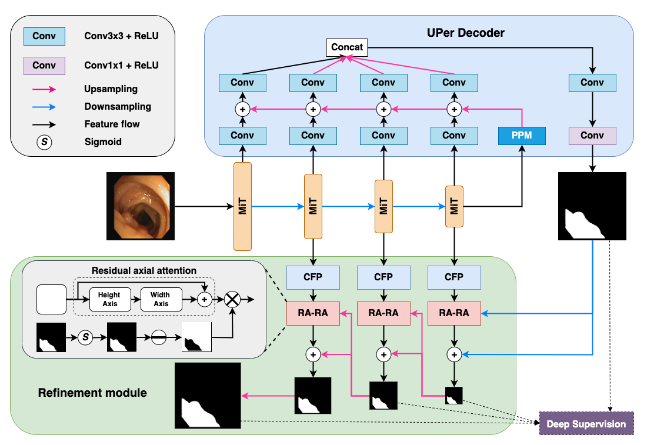

- Giới thiệu chung Áp dụng học sâu vào lĩnh vực xử lý ảnh y tế từ trước tới nay luôn chiếm khá nhiều quan tâm của giới học giả nghiên cứu vì tính thách thức cũng như khả năng ứng dụng thực tế. Chính vì thế mà các mô hình ưu việt cứ cách một khoảng thời gian ngắn lại được đề xuất. Gần đây thầy cô trường đại học Bách Khoa Hà Nội kết hợp với các thầy cô khác đến từ đhqg Hồ Chí Minh và học viện nô...

Mở đầu

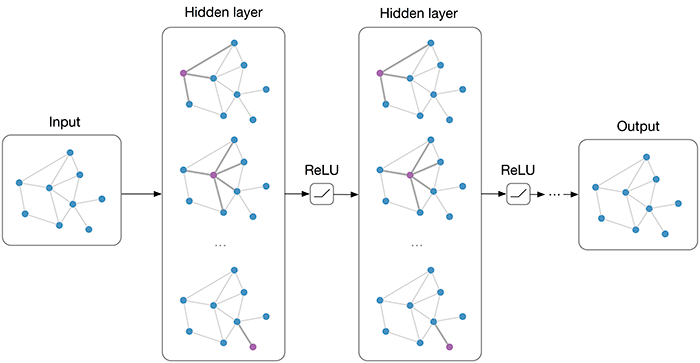

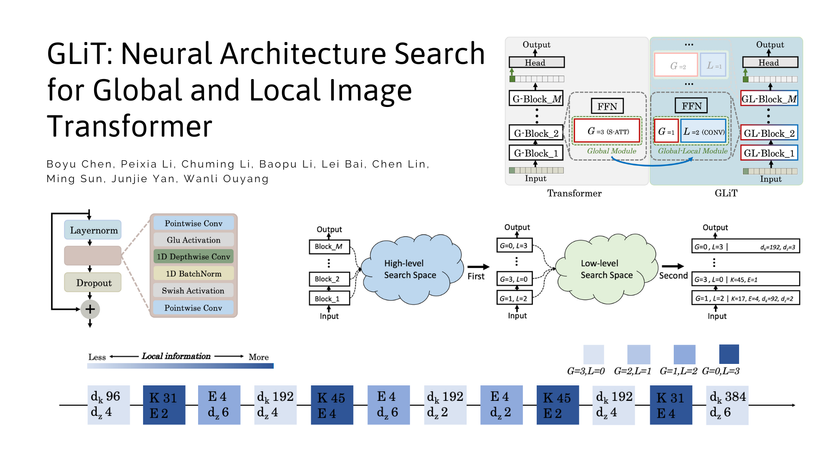

Trong thời gian qua, các kiến trúc dựa trên Convolutional Neural Networks (CNN) đã và đang có những thành công đáng kể trong các tác vụ học sâu. Tiếp đó, được lấy cảm hứng từ thành công vượt trội của Transformer trong các tác vụ xử lý tự nhiên, một lượng lớn nghiên cứu được công bố trong thời gian qua đã và đang tập trung việc phát triển các kiến trúc hiệu quả hơn dựa trên Transformer m...

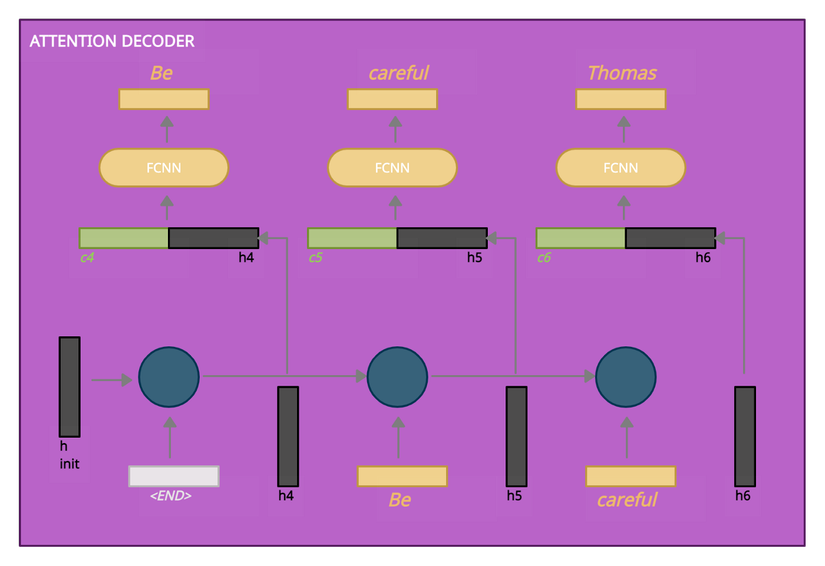

Xin chào các bạn, bài viết hôm nay mình sẽ chia sẻ về Attention trong Sequence 2 sequence model. Như các bạn cũng biết Attention là một state-of-the-art model và cũng đã được mọi người ứng dụng và thử nghiệm trong nhiều bài toán. Và chúng ta cùng theo dõi xem vì sao Attention lại góp phần vào sự thành công của nhiều model deep learning khác trong đó có Seq2Seq mà mình sẽ chia sẻ ở dưới đây.

At...

Lời mở đầu Chào các bạn,

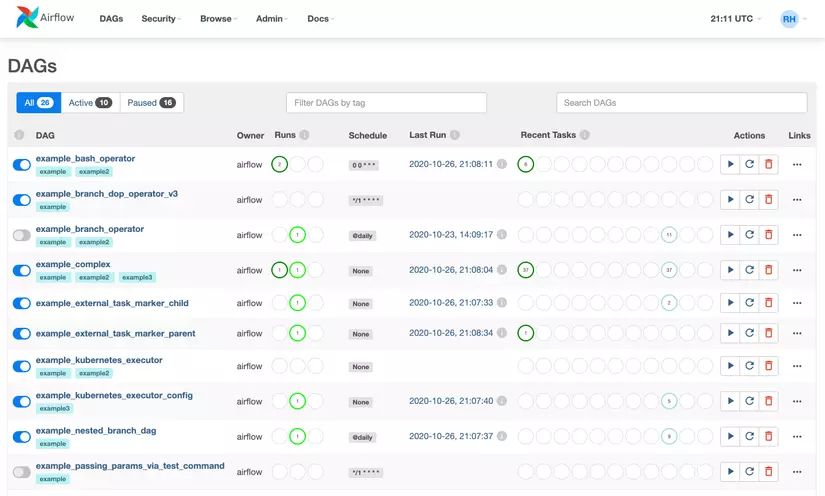

Do dòng đời xô đẩy nên tôi lại viết tiếp đây. Chủ đề hôm này là Airflow, chi tiết sẽ có trong các mục phía dưới

Do lượng kiến thức về framework này khá lớn nên tôi sẽ cố gắng viết các phần nối tiếp nhau, bạn đọc chú ý.

Khái niệm về Airflow Airflow là một công cụ lập lịch trình cho luồng công việc của bạn cũng như hỗ trợ quản lý, theo dõi từng phần trong quy trình giú...

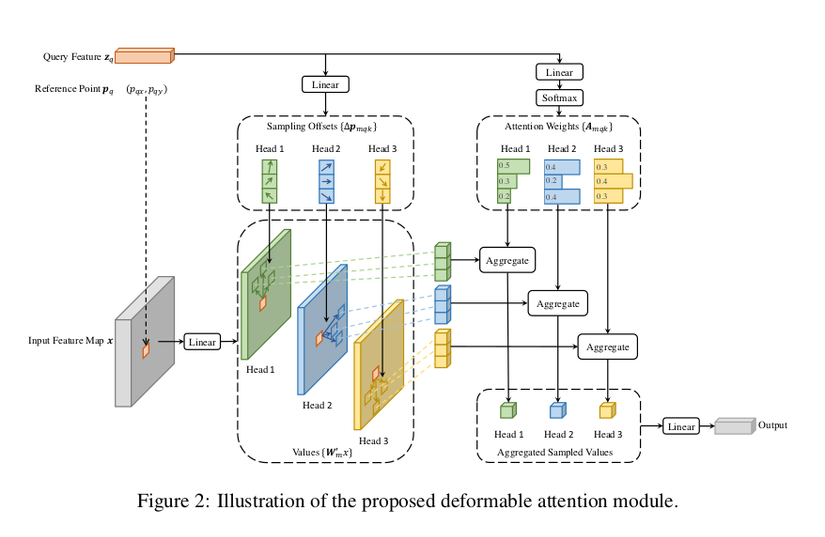

- Giới thiệu chung Trong bài viết lần trước mình đã giới thiệu về DETR một hướng tiếp cận mới cho bài toán Object Detection để hiểu một cách chọn vẹn Deformable DETR mình khuyến nghị mọi người nên đọc bài viết về DETR của mình trước https://viblo.asia/p/object-detection-with-transfromer-detr-eW65GpmjKDO. Mặc dù hướng tiếp cận khá hay nhưng DETR vẫn còn một số vấn đề như:

- DETR có kết quả khá ...

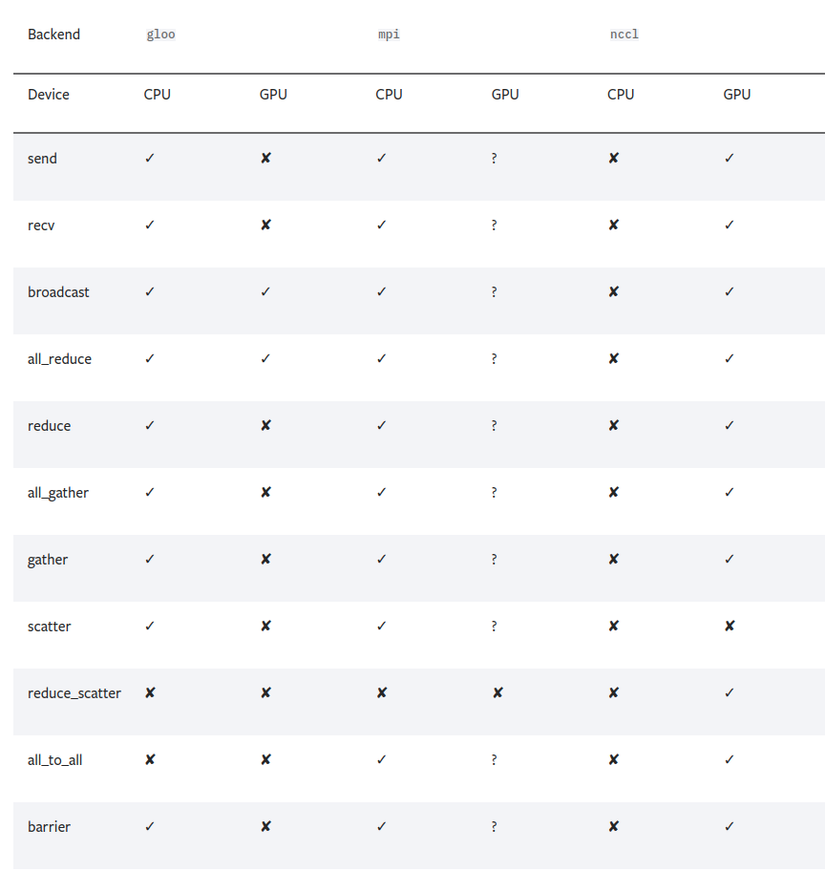

Lời mở đầu Chào các bạn, lâu rồi không viết bài trên Viblo nên hôm nay tôi tâm sự chút trải nghiệm của mình khi huấn luyện mô hình trên nhiều máy tính (multi-node training).

Chả là, đồng nghiệp tôi toàn kháo nhau về huấn luyện mô hình trên một máy có nhiều gpu (distributed training on single node) ... ờ thì lúc đầu tôi chẳng thấy hứng thú gì cho lắm, cho đến khi dính phải một cái dự án cần tra...

- Sơ bộ về Self-Attention và Transformer 1.1 Self Attention

Trong ví dụ trên, đầu vào bao gồm hai câu: "the rabbit quickly hopped" và "the turtile slowly crawled". [SEP] là token đặc biệt ngăn cách giữa các câu, [CLS] là token được thêm vào đầu câu sử dụng cho classification tasks. Hình ảnh biểu diễn cho mỗi từ ở bên trái với những từ ở bên phải sẽ có trọng số nhất định. Độ đậm của màu thể hi...

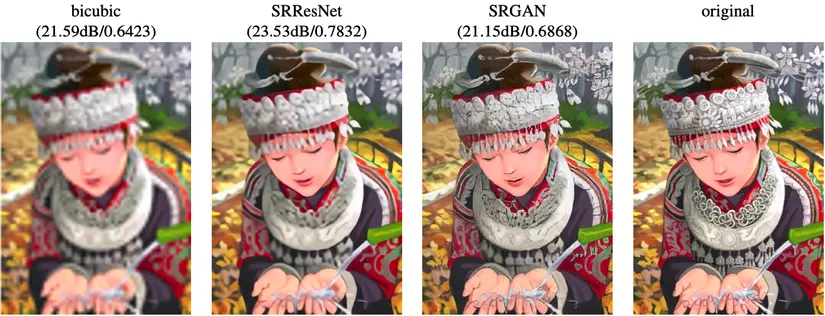

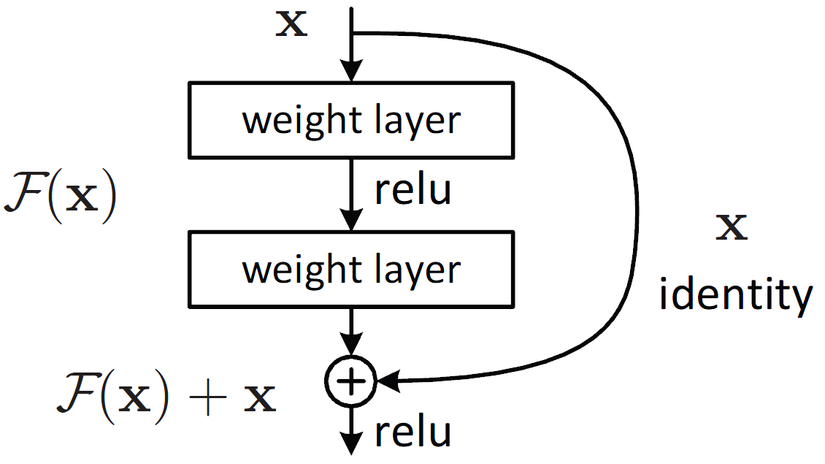

Giới thiệu Mặc dù việc upscale ảnh bằng mạng CNN đã đạt được nhiều tiến bộ đáng kể về độ chính xác và thời gian chạy, ta vẫn còn một vấn đề lớn vẫn chưa được giải quyết: làm sao để khôi phục được các chi tiết trên bề mặt các object, nhất là khi hệ số upscale lớn (3x, 4x,...)? Bài báo "Photo-Realistic Single Image Super-Resolution Using a Generative Adversarial Network" sẽ giải quyết vấn đề này ...

I. Tổng quan

<img src="https://images.viblo.asia/f42e0229-a318-4346-8f4f-d6b0ba476f02.png" >

Ứng dụng bài toán Text Recognition (ảnh mạng)

Bài toán nhận dạng chữ đến nay đã thu hút rất nhiều học giả nghiên cứu vì tính thách thức cũng như khả năng ứng dụng thực tế của bài toán này. Bài toán này có nhiệm vụ chuyển vùng chữ được xác định bởi mô hình phát hiện chữ ở dạng ảnh về dạng c...

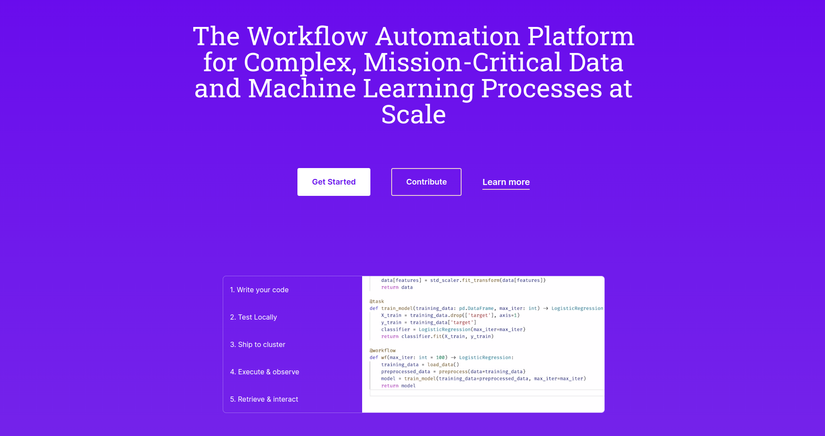

Trái ngược với việc Machine Learning đã và đang có vô vàn ứng dụng trong thực tế trong hơn vài thập kỷ qua, công cụ hỗ trợ các nhà nghiên cứu và kỹ sư trong lĩnh vực này vẫn đang phát triển. Vậy nên khi các mô hình trở nên phức tạp và các nguồn dữ liệu trở nên đa dạng, cơ sở hạ tầng, đặc biệt là các cơ sở hạ tầng cấp thấp như Kubernetes, mạng, trình điều khiển GPU, quản lý tài nguyên, v.v sẽ tr...

Giới thiệu Trong những năm trở lại đây semi-supervised learning đã và đang trở thành chủ đề được ứng dụng và nghiên cứu trong nhiều lĩnh vực khác nhau(xử lý hình ảnh, xử lý ngôn ngữ, tiếng nói ..vv). Trong đó việc ứng dụng semi-supervised learning để cải thiện hiệu quả cho các bài toán về segmentation đang được xem là một trong số những xu hướng nghiên cứu những năm gần đây. Trong bài viết lần ...

I. Giới thiệu Ở trong phần 1 của bài viết Bài toán phát hiện chữ (Text Detection) và mô hình DB (Phần 1) , tôi đã giới thiệu tổng quan các mô hình phát hiện chữ và mô hình phát hiện chữ DB. Trong bài viết hôm nay, tôi sẽ giới thiệu cho các bạn một phiên bản cải tiến của mô hình DB là DB++ được giới th...

I. Tổng quan bài toán phát hiện chữ

<img src="https://images.viblo.asia/78e9f605-137f-4e93-88f2-9fe6807b9885.png" >

Ảnh 1: Minh họa ứng dụng phát hiện chữ trong thực tế

Bài toán phát hiện chữ trong ảnh là bài toán xác định vị trị vùng có chữ trong ảnh đã trở nên phổ biến cả về mặt ứng dụng và nghiên cứu vì khả năng ứng dụng của nó . Đến hiện tại, bài toán phát hiện chữ trong ảnh thường ...

Mở đầu Đây là một paper khá hay phân tích về việc làm thế nào để thiết kế một model thực sự là hiệu quả về mặt tốc độ, điện năng tiêu thụ và độ chính xác. Nó đạp đổ toàn bộ những mạng nơ-ron tự xưng là cực nhẹ và tốc độ cao ra đời trước đó như MobileNet, ShuffleNet,... bổ sung thêm những kiến thức cần thiết cho việc thiết kế một model nhẹ. Hơn nữa, mình thấy paper này có những cách đặt vấn đề v...

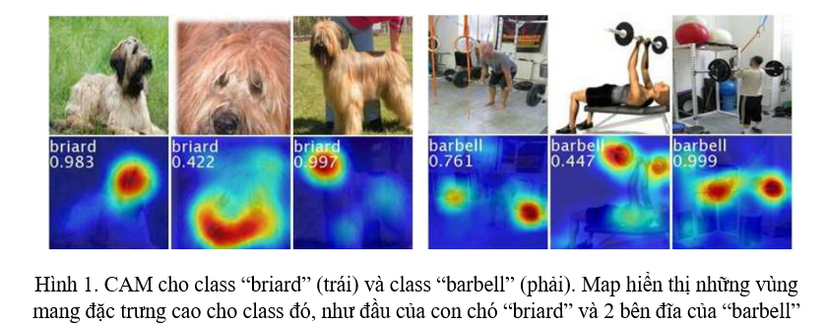

Giới thiệu Explainable AI Sự thành công của Deep Neural Network (DNN - mạng nơ-ron sâu) đã mang đến những bước tiến lớn trong các ứng dụng, nghiên cứu A.I (trí tuệ nhân tạo). Mặc dù vô cùng thành công, nhưng DNN hoạt động giống như một chiếc hộp đen, ta không biết tại sao mạng nơ-ron lại đưa ra một quyết định cụ thể. Do đó, khi một hệ thống A.I dự đoán sai, ta không hề biết tại sao hệ thống đó ...